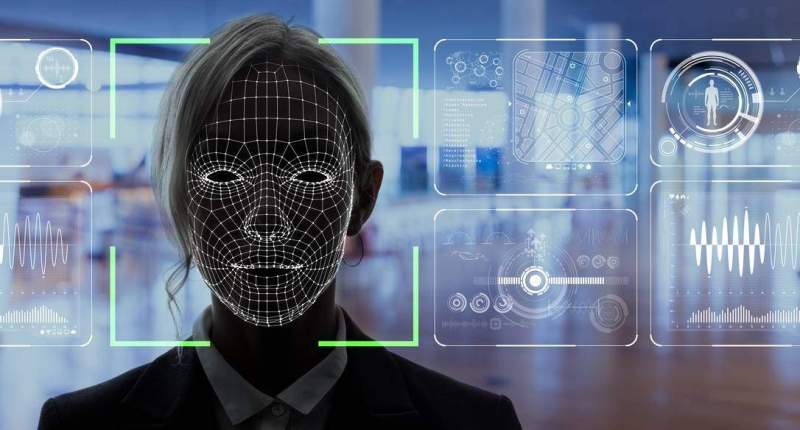

Um projeto lançado em janeiro de 2021 permite que qualquer pessoa verifique se as suas fotos estão sendo utilizadas por sistemas de reconhecimento facial. Esse é o Exposing.ai, que promete dar aos seus usuários um pouco de controle de volta em relação às suas próprias fotos.

A plataforma pesquisa quase 4 milhões de fotos do Flickr para realizar a verificação. O sistema procura em seis bases de dados do Flickr escaneadas no passado por instituições que fazem o reconhecimento facial.

Momentos íntimos

Liz O’Sullivan, uma das idealizadoras do projeto, afirmou que “as pessoas precisam entender que os seus momentos mais íntimos foram transformados em armas por terceiros”, em entrevista ao The New York Times. Além das fotos, os sistemas de inteligência artificial (IA) utilizam vídeos, áudios e outros dados para aprender sobre o comportamento humano.

Muitas vezes, esses sistemas se destinam a fins comerciais desconhecidos pelo grande público. Também é comum não que as fotos utilizadas pela IA dos governos e das empresas não tenham sido fornecidas voluntariamente pelas pessoas.

Isso acontece porque os usuários abrem mão da própria privacidade ao aceitar os “termos e condições” das redes sociais sem lhes dar a devida atenção. Ainda assim, a tecnologia do Exposing.ai verifica apenas as fotos do Flickr, mas não das demais redes sociais, como o Facebook ou o Twitter.

Reconhecimento facial para militares

As fotos escaneadas pelos sistemas de inteligência artificial são empregadas para fins acadêmicos, corporativos ou até mesmo militares. Normalmente, as empresas empregam a IA para aprender padrões de consumo e aumentar os seus indicadores de venda. Mas há um lado mais sombrio da relação entre a IA e as fotos publicadas nas redes sociais.

Na China, o reconhecimento facial avançado se faz presente em diversos locais públicos, incluindo aeroportos, praças, ruas, museus e pontos turísticos. Por lá, os chineses não são os únicos monitorados, já que o sistema das autoridades locais também consegue reconhecer estrangeiros, conforme mostrou o Fantástico há alguns anos.

No caso do Exposing.ai, quem utilizou o Flickr entre 2004 e 2020 consegue ver se as suas fotos foram escaneadas por sistemas de reconhecimento facial. O controle do Flickr mudou várias vezes no decorrer dos anos, o que aumenta as chances de uso indevido da imagem da sua base de usuários.