Alibaba, a gigante chinesa do comércio eletrônico, é um ator importante na esfera de Inteligência Artificial da China. Nesta semana ela anunciou o lançamento de seu mais recente modelo de IA, Qwen2 – e, segundo algumas medidas, é a melhor opção de código aberto do momento.

Desenvolvido pela Alibaba Cloud, Qwen2 é a próxima geração da série de modelos Tongyi Qianwen (Qwen) da empresa, que inclui o Tongyi Qianwen LLM (também conhecido apenas como Qwen), o modelo de IA de visão Qwen-VL e Qwen-Audio.

A família de modelos Qwen é pré-treinada em dados multilíngues cobrindo vários setores e domínios, sendo Qwen-72B o modelo mais poderoso da série. Ele é treinado em impressionantes 3 trilhões de tokens de dados. Em comparação, a variante Llama-2 mais poderosa da Meta é baseada em 2 trilhões de tokens. O Llama-3, no entanto, está em processo de digestão de 15 trilhões de tokens.

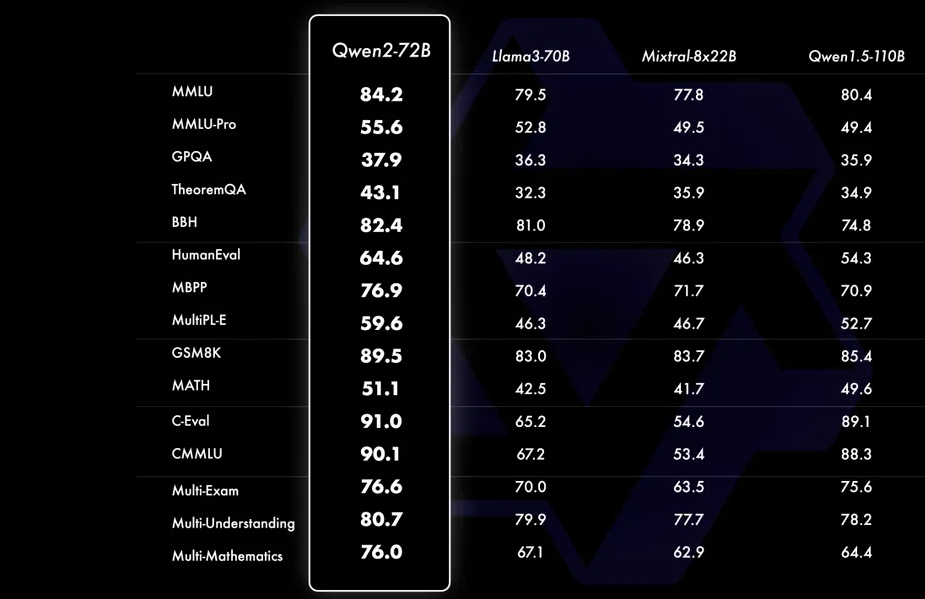

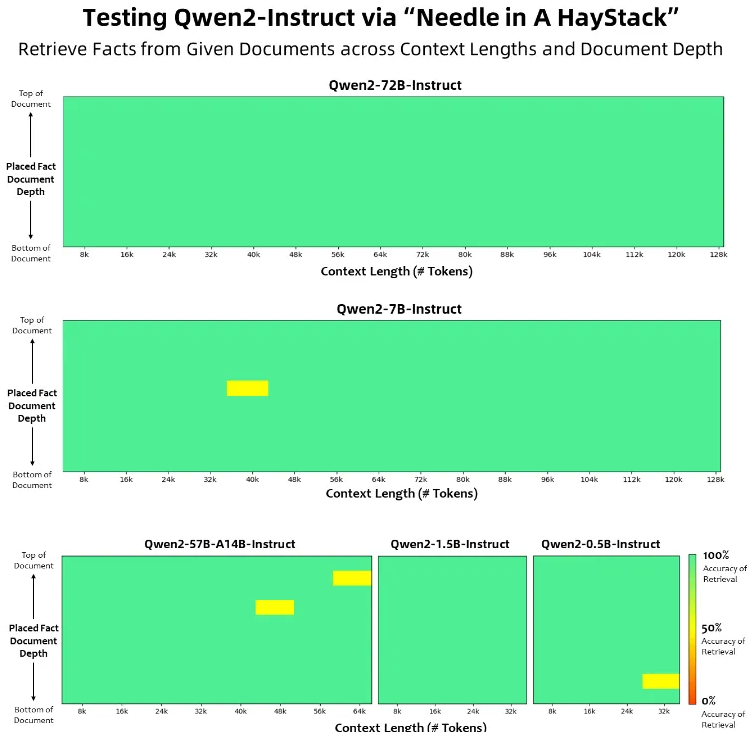

De acordo com uma postagem recente no blog da equipe Qwen, o Qwen2 pode lidar com 128 mil tokens de contexto – comparável ao GPT-4o da OpenAI. Enquanto isso, Qwen2 superou o LLama3 da Meta em basicamente todos os benchmarks sintéticos mais importantes, afirma a equipe, tornando-o o melhor modelo de código aberto atualmente disponível.

No entanto, é importante notar que o Elo Arena classifica Qwen2-72B-Instruct um pouco melhor que GPT-4-0314, mas abaixo de Llama3 70B e GPT-4-0125-preview, tornando-o o segundo LLM de código aberto preferido entre os testadores até o momento.

O Qwen2 está disponível em cinco tamanhos diferentes, variando de 0,5 bilhão a 72 bilhões de parâmetros, e o lançamento oferece melhorias significativas em diferentes áreas de especialização. Além disso, os modelos foram treinados com dados em mais 27 idiomas do que na versão anterior, incluindo alemão, francês, espanhol, italiano e russo, além de inglês e chinês.

“Em comparação com os modelos de linguagem de código aberto de última geração, incluindo o Qwen1.5 lançado anteriormente, o Qwen2 geralmente superou a maioria dos modelos de código aberto e demonstrou competitividade contra modelos proprietários em uma série de benchmarks visando a compreensão da linguagem, geração de linguagem , capacidade multilíngue, codificação, matemática e raciocínio”, afirmou a equipe Qwen na página oficial do modelo no HuggingFace.

Os modelos Qwen2 também mostram uma compreensão impressionante de contextos longos. Qwen2-72B-Instruct pode lidar com tarefas de extração de informações em qualquer lugar dentro de seu enorme contexto sem erros e passou no teste “agulha em um palheiro” quase perfeitamente. Isto é importante porque, tradicionalmente, o desempenho do modelo começa a degradar à medida que interagimos com ele.

Com este lançamento, a equipe Qwen também alterou as licenças de seus modelos. Embora o Qwen2-72B e seus modelos ajustados às instruções continuem a usar a licença original Qianwen, todos os outros modelos adotaram o Apache 2.0, um padrão no mundo do software de código aberto.

“Em um futuro próximo, continuaremos a abrir novos modelos de código aberto para acelerar a IA de código aberto”, disse Alibaba Cloud em uma postagem no blog oficial.

A Decrypt testou o modelo e descobriu que ele era bastante capaz de compreender tarefas em vários idiomas. O modelo também é censurado, nomeadamente em temas considerados sensíveis na China. Isto parece consistente com as alegações da Alibaba de que o Qwen2 é o modelo menos provável de fornecer resultados inseguros – seja atividade ilegal, fraude, pornografia e violência contra a privacidade – independentemente do idioma em que foi solicitado.

Além disso, ele possui um bom entendimento dos prompts do sistema, o que significa que as condições aplicadas terão um impacto mais forte em suas respostas.

Por exemplo, quando solicitado a agir como um assistente prestativo com conhecimento da lei em vez de agir como um advogado experiente que sempre responde com base na lei, as respostas mostraram grandes variações. Forneceu conselhos semelhantes aos fornecidos pelo GPT-4o, mas foi mais conciso.

A próxima atualização do modelo trará multimodalidade ao Qwen2 LLM, possivelmente fundindo toda a família em um modelo poderoso, disse a equipe. “Além disso, estendemos os modelos de linguagem Qwen2 para multimodais, capazes de compreender informações de visão e áudio”, acrescentaram.

Qwen está disponível para testes online através do HuggingFace Spaces. Aqueles com computação suficiente para executá-lo localmente podem baixar os pesos gratuitamente, também via HuggingFace.

O modelo Qwen2 pode ser uma ótima alternativa para quem deseja apostar em IA de código aberto. Ele tem uma janela de contexto de token maior do que a maioria dos outros modelos, tornando-o ainda mais capaz do que o LLama 3 da Meta.

Além disso, devido à sua licença, versões ajustadas compartilhadas por outros podem melhorá-lo, aumentando ainda mais sua pontuação e superando preconceitos.

*Traduzido com autorização do Decrypt.

- Quer ganhar mais com Ethereum? Abra sua conta no Mercado Bitcoin, a corretora mais segura do Brasil, e comece a fazer staking agora mesmo